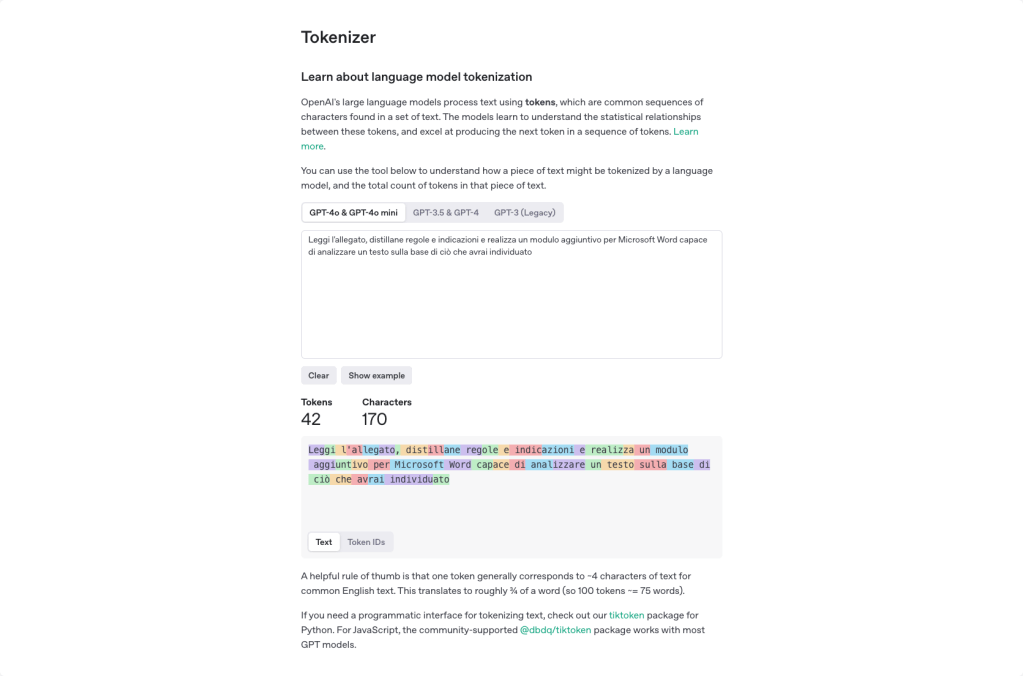

I grandi modelli di linguaggio elaborano il testo utilizzando i token, che sono sequenze comuni di caratteri presenti in un insieme di testo. I modelli imparano a capire le relazioni statistiche tra questi token ed eccellono nel produrre il token successivo in una sequenza di token. I token rappresentano sequenze di caratteri che si verificano comunemente. Ad esempio, la stringa “tokenizzazione” è decomposta come “token” e “ization”, mentre una parola breve e comune come “il” è rappresentata come un singolo token. Si noti che in una frase, il primo token di ogni parola in genere inizia con un carattere di spazio.